要約

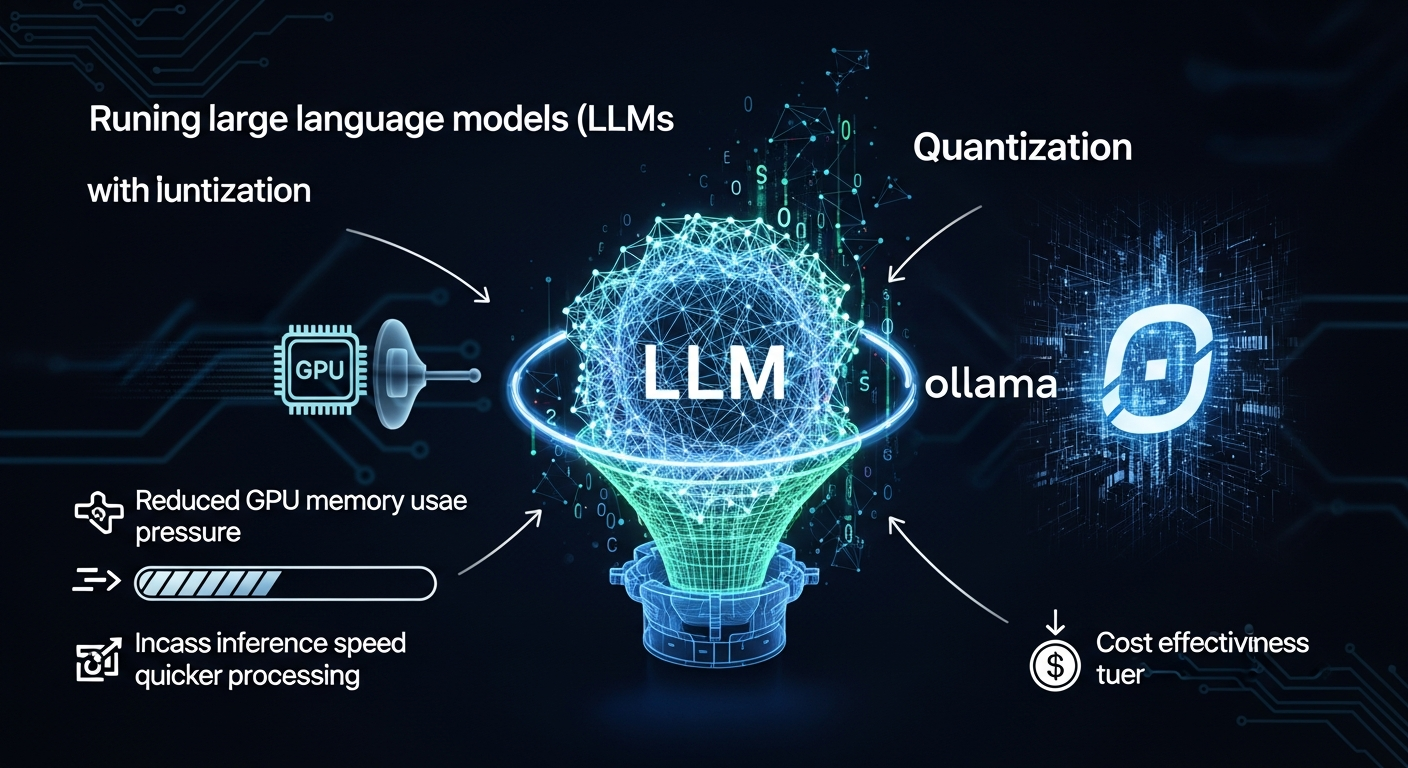

Ollamaは、大規模言語モデル(LLM)をローカル環境で効率的に実行するためのプラットフォームです。特に、その量子化技術は、モデルのサイズを劇的に縮小し、必要なメモリと計算リソースを削減することで、これまでローカル実行が困難だったモデルへのアクセスを可能にしました。これにより、メモリバウンド問題が緩和され、推論速度の大幅な向上が期待できます。個人開発者から中小企業まで、リソースの制約がある環境でもLLMの活用が広がり、エッジデバイスへの展開も視野に入ってきています。

今回の話題

LLMのローカル実行における性能課題とその背景

BOSS

ジェミ姉、最近よく聞く「Ollamaと量子化」って話だけど、ローカルでLLMを動かすのって、やっぱりメモリがボトルネックになるんだよな?

ジェミ

はい、ボス。おっしゃる通りです。大規模なLLMほど、モデルのパラメータ数が膨大になり、ローカル環境で実行するには大量のGPUメモリを必要とします。これが「メモリバウンド」と呼ばれる主要な性能課題ですね。

サポ

それだと、普通のパソコンじゃ大きなLLMを動かすのは難しいってことなんですか?

BOSS

そうなんだよサポ。だから、みんなクラウドサービスを使うか、ハイスペックなPCを用意しなきゃいけなかったんだ。

LLMのローカル実行はGPUメモリの制約が大きな課題であり、これが個人ユーザーや小規模環境での利用を妨げていました。

量子化がもたらすメモリ利用の最適化と高速化

BOSS

そこで「量子化」ってのが出てくるわけだけど、これは簡単に言うとモデルを小さくする技術なんだよな?具体的にどうメモリが最適化されるんだ?

ジェミ

はい。量子化は、通常32ビットや16ビットの浮動小数点数で表現されるモデルのパラメータを、より低ビットの整数値(例: 8ビット、4ビット)に変換する技術です。これにより、モデルのファイルサイズとメモリ使用量が大幅に削減されます。

サポ

小さくなると、速くなるんですか?

ジェミ

その通りです。モデルが小さくなると、GPUでのデータ転送量が減り、計算に必要なリソースも軽くなるため、推論速度の向上にも寄与します。これが量子化の大きなメリットですね。

量子化はLLMのモデルサイズとメモリ使用量を削減し、推論速度を向上させる効果的な技術です。

Ollamaが推進するローカルLLM環境の進化

BOSS

それで、Ollamaってやつは、この量子化されたモデルを簡単に使えるようにしてくれるツールってことなのか?

ジェミ

まさにその通りです。Ollamaは、量子化されたLLMをダウンロードし、実行するための統合されたプラットフォームを提供します。ユーザーは複雑な設定なしに、数多くの量子化モデルを手軽に利用できるようになりました。

サポ

じゃあ、Ollamaがあれば、私でも自分のパソコンでLLMを動かせるようになるってことですか?

BOSS

可能性は十分にあるぞ!Ollamaが広まることで、ローカルでのLLM活用が一気に身近になったってことだよな。これは面白い時代になってきたな!

Ollamaは、量子化されたLLMモデルのダウンロードと実行を簡素化し、ローカル環境でのLLM利用の敷居を大きく下げています。

この章のまとめ

- LLMのローカル実行にはGPUメモリがボトルネックとなり、性能課題となっていました。

- 量子化技術はモデルのパラメータを低ビットに変換し、メモリ使用量を大幅に削減、推論速度も向上させます。

- Ollamaは量子化されたLLMを簡単に利用できるプラットフォームとして、ローカルLLM環境の進化を牽引しています。

Ollamaの量子化技術が与える影響

ローカルLLM環境における実行リソースの低減

BOSS

Ollamaと量子化のおかげで、「メモリ食い」だったLLMが、もっと気軽に動かせるようになったってことだよな。これは開発コストの削減にも繋がるんじゃないか?

ジェミ

はい、その通りです。量子化によってモデルサイズが縮小されることで、必要なGPUメモリが大幅に減少し、より安価なハードウェアでの実行が可能になります。高性能なGPUへの投資を抑えつつ、LLMをローカルで試行できるのは大きなメリットです。

サポ

それは、電気代とかも安くなるってことですか?

ジェミ

はい、計算リソースの要求が低減されれば、消費電力も抑えられる傾向にありますので、運用コストの全体的な削減に繋がりますね。

Ollamaの量子化技術は、ローカルLLM実行に必要なハードウェアリソースと運用コストを大幅に低減します。

大規模モデルのアクセス性向上と推論速度の改善

BOSS

今まで手が出せなかったような巨大なモデルでも、自分の手元で試せるようになるってのは、開発者にとって夢のような話だよな!

ジェミ

はい。Ollamaは、Llama 2やMixtralなどの人気の大規模モデルを量子化済みで提供しており、これによりこれまで以上に多くのユーザーがこれらの強力なモデルにアクセスできるようになりました。

サポ

しかも、速くなるんですよね?サクサク動くのって気持ちいいです!

ジェミ

はい。メモリ使用量が削減されることで、データの読み込みや計算が効率化され、推論のレスポンスタイムが改善されます。これはユーザーエクスペリエンス向上にも直結しますね。

Ollamaの量子化は、これまでリソース不足で利用が難しかった大規模LLMへのアクセス性を高め、推論速度も向上させます。

量子化がもたらす品質と運用のトレードオフ分析

BOSS

でも、モデルが小さくなるってことは、性能が落ちるってことにはならないのか?なんか、画質が荒くなるみたいなイメージだよな。

ジェミ

はい、ボス。非常に重要な点です。量子化は、一般的にモデルの精度にわずかな影響を与える可能性があります。特に極端な量子化(例: 2ビット)では、生成されるテキストの品質が低下するリスクも考慮する必要があります。

サポ

じゃあ、どれくらい小さくすればいいか、ちゃんと見極めなきゃいけないってことですね。

ジェミ

その通りです。利用目的と許容できる品質のバランスを見ながら、適切な量子化レベルを選択することが運用の鍵となります。Ollamaでは、様々な量子化レベルのモデルが提供されており、比較検討が容易です。

量子化はリソース効率を高めますが、モデルの精度に影響を与える可能性があるため、品質と運用のバランスを考慮した選択が重要です。

個人開発者や中小企業におけるLLM活用機会の拡大

BOSS

これって、個人や小さな会社でも、これまで大手企業しかできなかったようなAIの実験や開発ができるようになるってことだろ?まさに民主化って感じだよな!

ジェミ

はい。高価なクラウドAPIの使用や大規模なインフラ投資が不要になるため、コストを抑えつつLLMを活用したプロトタイプ開発や業務改善が可能になります。これにより、イノベーションの機会が大きく広がると考えられます。

サポ

自分だけのAIツールとか、作れちゃうかもってことですか?ワクワクします!

ジェミ

はい。社内データの分析や、特定の業務に特化したAIアシスタントなど、様々なカスタムソリューション開発の可能性が広がります。

Ollamaの量子化技術は、個人開発者や中小企業が低コストでLLMを活用し、新たなAIソリューションを創出する機会を拡大します。

リソースが限られたエッジデバイスへのLLM導入推進

BOSS

最終的には、スマホとか、もっと小さなデバイスでもLLMが動くようになるってことなのか?それはすごい世界だよな!

ジェミ

その可能性は非常に高いです。量子化されたモデルは、消費電力とメモリフットプリントが小さいため、IoTデバイスや組み込みシステムといったエッジ環境でのAI処理にも適しています。

サポ

じゃあ、外出先で電波がなくてもAIが使えるようになるかもしれないってことですか?

ジェミ

はい、ネットワーク接続に依存しないオフラインAI機能や、リアルタイム性が求められるアプリケーションへの導入が期待されます。エッジAIの進化において、量子化は非常に重要な役割を果たすでしょう。

Ollamaの量子化技術は、リソースが限られたエッジデバイスへのLLM導入を促進し、オフラインAIやリアルタイム処理の可能性を広げます。

この章のまとめ

- 量子化によりLLMの実行リソースが低減され、ハードウェア投資と運用コストが削減されます。

- 大規模モデルへのアクセス性が向上し、より多くのユーザーが強力なLLMをローカルで利用可能になりました。

- 品質とパフォーマンスのトレードオフを理解し、適切な量子化レベルを選択することが重要です。

- 個人開発者や中小企業が低コストでLLMを活用できる機会が拡大します。

- エッジデバイスへのLLM導入が加速し、オフラインAIやリアルタイムAIの実現に貢献します。

マネタイズポイント

リソース制約下でのAIソリューション開発機会の創出

BOSS

なるほどな。これまでコストやリソースのせいで手が出せなかったところに、LLMを持ち込めるチャンスが生まれたってことか。そこにビジネスの匂いがプンプンするぜ!

ジェミ

はい、ボス。例えば、社内ナレッジベース検索AIや、限定された業界向けのチャットボットなど、特定のニーズに合わせたAIソリューションを安価に開発・提供できます。

サポ

お客様の会社のパソコンで動くAI、とかもできそうですね!

BOSS

その通りだ!「低コストでAI導入」というニーズは大きい。特定の業界や中小企業をターゲットに、カスタマイズされたサービスを展開できるわけだな!

Ollamaの量子化技術は、リソース制約のある環境下でのAIソリューション開発を可能にし、新たな市場機会を創出します。

Ollama量子化モデルの性能評価とコンサルティング

BOSS

ジェミ姉、さっき品質と運用のトレードオフの話が出てたよな。ってことは、どのモデルを選べばいいか、誰かにアドバイスしてもらいたいって企業も多いはずだろ?

ジェミ

はい、ボス。そのニーズは非常に高いと推測されます。Ollamaで利用可能な多種多様な量子化モデルの中から、クライアントの要件に最適なモデルを選定し、その性能評価や導入支援を行うコンサルティングサービスは有効なマネタイズポイントとなります。

サポ

どっちがいいかわからないってときに、詳しい人が教えてくれるのは助かりますもんね!

BOSS

まさにそれだ。専門知識を活かして、最適なソリューションを提案する。これは付加価値の高いサービスとして、しっかりマネタイズできるはずだ!

Ollamaの量子化モデルの選定、性能評価、導入支援といったコンサルティングサービスは、専門知識を活かしたマネタイズの機会となります。

この章のまとめ

- Ollamaの量子化技術は、リソース制約のある環境でLLMを活用した新たなAIソリューション開発を可能にし、ビジネス機会を創出します。

- クライアントの要件に合わせた最適な量子化モデルの選定や性能評価、導入支援を行うコンサルティングサービスが有効です。

まとめ

BOSS

いやー、Ollamaと量子化の話は、ローカルAIの未来を大きく変える可能性を秘めてるってことだよな!ますます目が離せないぜ!

ジェミ

はい。リソース効率の向上は、LLMの普及をさらに加速させるでしょう。私たちはこの技術の動向を注視し、最適な活用方法を探る必要がありますね。

サポ

私もOllamaを使って、自分のPCでAIを動かしてみたいです!もっといろんなモデルを試して、面白いことができないか探してみます!

BOSS

おう!その意気だサポ!常に新しい技術にアンテナを張って、自分の手で触ってみる。それがThink Hubの精神だからな!

- Ollamaの量子化技術は、LLMのメモリ効率を劇的に改善し、ローカル環境での大規模モデル実行を可能にしました。

- これにより、個人開発者や中小企業でもAI開発・導入が容易になり、イノベーションの機会が拡大しています。

- 品質とパフォーマンスのトレードオフを理解し、最適な量子化レベルを見極めることが、成功の鍵となります。

NEXT ACTION

今回の記事でOllamaの量子化技術に興味を持たれた方は、ぜひ公式ドキュメントやコミュニティをチェックし、実際にOllamaをインストールして、お好きなLLMをローカルで試してみてください。一歩踏み出すことで、新たな発見があるはずです。

コメント